¿Cómo la empresa de cloud más grande del mundo, la referencia técnica para developers durante más de una década, quedó tercera en la carrera por infraestructura de AI? ¿Al punto de tener que invertir en OpenAI a valores 15 veces superiores que Microsoft, sin ninguna de sus ventajas contractuales? ¿Por qué hasta Google, que tiene todo el stack de AI completo de forma propietaria, invirtió más y mejor en Anthropic que Amazon? ¿Dónde perdió el rumbo AWS?

Esas preguntas que tenía en la cabeza me quedaron dando vueltas después de leer que Amazon anunciaba una inversión de hasta $50B en OpenAI a un precio altisimo y sin una sola ventaja competitiva. La respuesta no es simple pero tampoco es un misterio y lo importante es el contexto de como Microsoft y Google los dejaron atrás

MIcrosoft y el su “Peaje Estructural”: Una Cobertura Perfecta

Para entender el tamaño del problema de Amazon, primero hay que entender qué construyó Microsoft entre 2019 y 2026. Satya Nadella no solo invirtió en OpenAI como una startup prometedora; construyó una posición estructural e inexpugnable en toda la economía de la AI.

Microsoft no invirtió simplemente un porcentaje de OpenAI (y de hecho hasta nos dió, al programa de Startups, una herramienta para atacar a AWS) sino que aseguró el futuro de su plataforma con claúsulas que no me canso de repetir porque no parecen entenderlas:

- Derechos de IP Blindados: Los acuerdos de Microsoft sobre los modelos de OpenAI se extienden hasta 2032 e incluyen modelos post-AGI (Inteligencia Artificial General). La clave es la cobertura: si OpenAI fracasa mañana como empresa, Microsoft conserva los pesos de los modelos, las arquitecturas, el código de inferencia y los métodos de fine-tuning. Es una póliza de seguro absoluta.

- Términos Financieros Exclusivos: Microsoft recibe el 75% de las ganancias de OpenAI hasta recuperar su inversión, y luego el 49% hasta alcanzar un tope. Amazon, en su trato de 2026, obtiene poco más que el título de “distribuidor exclusivo de nube de terceros”, una exclusividad que es más marketing que realidad.

- La Combinación Letal (The Toll Booth): El verdadero “moat” de Microsoft no es solo Azure. Es la integración vertical de Azure + IP de OpenAI + GitHub + Microsoft 365. Cobran peaje en cada capa:

- Infraestructura: Azure crece al 38-40% anual (vs. 17-18% de AWS). Azure AI Foundry tiene más de 80,000 clientes, incluyendo el 80% del Fortune 500.

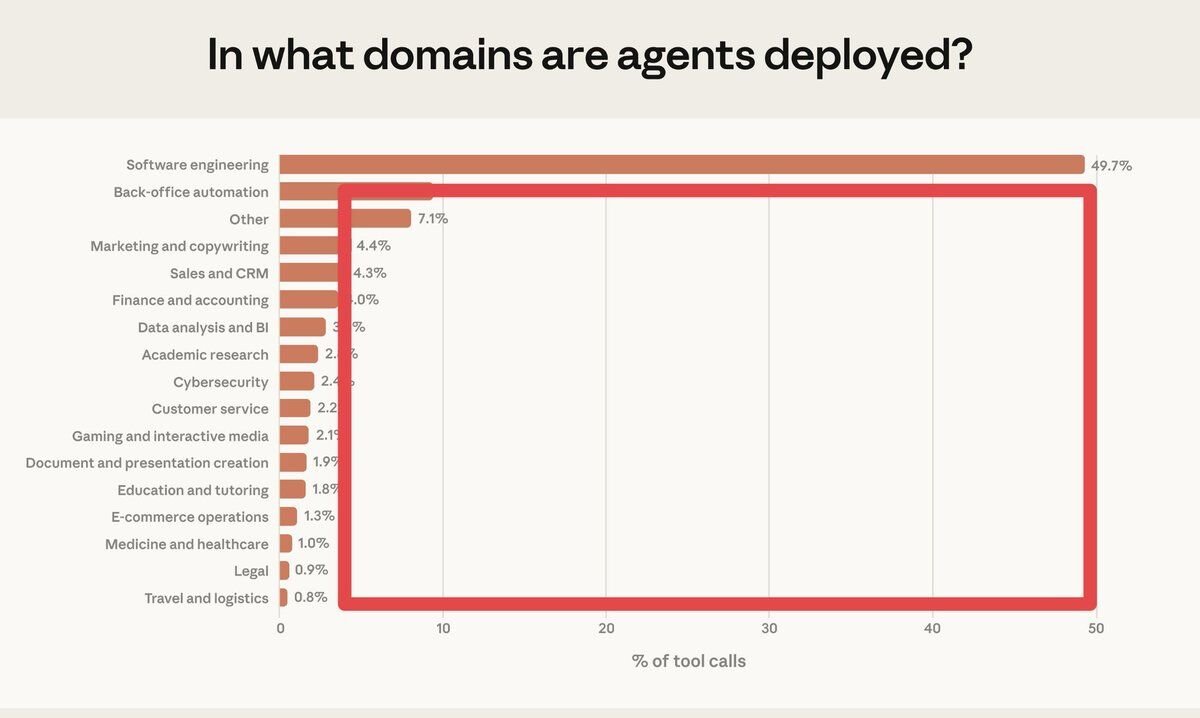

- Desarrollo: GitHub Copilot domina el 42% del mercado de herramientas de codificación de AI con 26 millones de usuarios.

- Productividad: Microsoft 365 Copilot tiene 15 millones de asientos pagos. La IA está embebida en el flujo de trabajo real.

Mientas Amazon compraba tickets de lotería apostando a modelos externos, Microsoft se convirtió en la plataforma donde todos esos modelos (incluido Claude de Anthropic que ahora esta integrado ) deben correr para llegar a la empresa.

Google y el miedo de un CEO a perder su fuente de ingresos

Google es el caso más complejo y sobre todo más interesante; para darles contexto Google lideraba tanto en AI que hace más de 10 años yo escribia sobre sus TPUs y su estrategia con un CEO que ya en ese momento no sabía como integrar, optimizar y comunicar su poderío en IA… al punto que en 2016 dije:

“es la primera vez que veo a un Google reactivo y no proactivo cuando tenía algo como los un chip creado por ellos mismos como “motor” de hardware para explotar el software que mueve varias de sus estrategias de AI y esto es un paso impresionante que pasó casi desapercibido”

Google, Apple y la pelea por la Inteligencia Artificial (Mayo, 23, 2016)

Y ahi tambien, ya se preveía el gran debate que apareció en 2022 recién, ¿como se alimentan esos modelos?:

“repito ¿como definen que todo lo que se habla es público o se puede responder en público o es un query para alimentar sus sistemas de entrenamiento? porque esto es clave para que ese mundo ideal de información constante, contextual, transparente y pervasiva sea una realidad.”

Google Assistant: la inteligencia pervasiva de Google (Mayo, 18, 2016)

Esto muestra algo clave, desde siempre y como señala Ben Thompson (Stratechery), Google es el único jugador completamente integrado verticalmente en AI.

Poseen el stack completo:

- Silicio Propio: Sus TPUs (v7 “Ironwood”) ofrecen un rendimiento masivo a un costo operativo 44% menor que las GPUs de NVIDIA.

- Modelos y Research: La fusión de DeepMind y Google Brain creó una potencia de investigación que ganó el Premio Nobel de Química en 2024 (AlphaFold) y produce modelos de vanguardia como Gemini 3.

- Distribución Masiva: Sus productos tienen miles de millones de usuarios cautivos (Search, Gmail, YouTube, Android).

El Retraso por Arrogancia y Miedo: Google tenía la tecnología (inventaron el transformer en 2017 y hoy ninguno de sus investigadores sigue en la empresa) y modelos avanzados (LaMDA, PaLM) mucho antes que ChatGPT. Pero sufrieron el “dilema del innovador” en su estado más puro porque Sundar Pichai es un CEO de la escuela de McKinsey en vez de ser un insider como Satya: Embeber IA generativa en Search canibalizaba el modelo publicitario que genera el 60% de sus ingresos. Tenían demasiado que perder.

De nuevo, Sundar seguiría analizando que hacer pero volvió Sergey Brin a la empresa, declaró un “Código Rojo” provocado por ChatGPT que hizo que vuelva Sergey Brin a la empresa, y con algunos tropiezos iniciales (Bard, problemas de imagen de Gemini), Google reaccionó con la urgencia que le faltaba. Para 2026, recuperaron terreno: Gemini App alcanzó 750 millones de usuarios mensuales y Google Cloud aceleró su crecimiento al 48%. Aunque el gap de engagement con OpenAI persiste, el moat estructural de Google es el más profundo de todos.

Amazon: El Rey desnudo, burocracia y falta de visión

¿Dónde perdió el rumbo AWS? La empresa que inventó la nube moderna se quedó rezagada por una combinación de complacencia, una apuesta masiva y fallida en hardware de consumo, y una crisis de gobernanza técnica.

El Fiasco de Alexa y el Costo de Oportunidad: Alexa fue una de las apuestas más caras y menos rentables de la historia corporativa. Amazon vendió 500 millones de dispositivos Echo a pérdida, esperando que se convirtiera en la plataforma de comercio por voz. La división perdió decenas de miles de millones de dólares (más de $25,000M solo entre 2017 y 2021). Cuando llegó la revolución de los LLMs, en lugar de pivotar agresivamente, Amazon intentó retrofitar la IA generativa sobre la arquitectura obsoleta de Alexa. El resultado (Alexa+) fue decepcionante. Amazon quemó años de enfoque y miles de millones de dólares en el “falso ídolo” de la voz, mientras Microsoft y Google invertían en la IA cognitiva de fondo.

Liderazgo de Ejecución vs. Liderazgo de Visión: Andy Jassy, el constructor de AWS, es un ejecutor legendario; de nuevo, es un tipo capaz de construir lo que es AWS y que, en definitiva, le dio el cash flow a Amazon para crecer su ecommerce.

Pero en IA, sin visión ¿de que te sirve saber ejecutar? La visión requiere estar dispuesto a apostar contra tu propio negocio actual. AWS se centró en ser la “tienda de departamentos” de modelos (Bedrock), ofreciendo opciones en lugar de una opinión clara y excelencia tecnica (ni hablemos de que sea propietaria como toda herramienta de AWS). Esta neutralidad histórica de AWS se convirtió en una debilidad cuando los clientes empresariales buscaban una guía clara en un panorama caótico.

Crisis de Gobernanza y Cultura de Ingeniería: Los problemas de Amazon no fueron solo estratégicos, sino operativos y culturales, evidenciando una preocupante falta de control sobre sus propias herramientas de IA:

- Diciembre 2025: Una herramienta de IA interna (Kiro) causó un outage de 13 horas en AWS al decidir eliminar un entorno live entero.

- Marzo 2026: El sitio de retail de Amazon cayó por seis horas. Memorandos internos revelaron que las herramientas de GenAI estaban suplementando instrucciones de cambios en producción, generando prácticas inseguras.

Dejenme ser claro: Una empresa que no puede controlar la IA en su propia infraestructura crítica tiene un problema de gobernanza que ninguna inversión puede solucionar rápidamente.

El Costo de Llegar Tarde: CAPEX negativo, MOAT minúsculo

Amazon llegó tarde y sus errores de implementación hacen que muchos ya ni lo mencionen, pero no soy tan terminante; como dije sobre Google hace un año:

Con este recorrido, no sorprende que muchos analistas y medios hayan declarado que Google perdió su moat en búsqueda e inteligencia artificial. El argumento es simple: lanzamiento tardío de Gemini (antes Bard), primeras versiones por detrás de ChatGPT y una integración que parecía tímida en su propio ecosistema. Pero acá es donde la historia se vuelve más interesante. En el largo plazo, la distribución es el rey. Y Google tiene un músculo de distribución que, ya decidido a usarlo a pleno, es difícil de igualar.

No, Google no esta muerto (Agosto, 13, 2025)

Hay un gran análisis de Om Malik que es lapidario: “There is no greatness in lateness”. El costo para Amazon de llegar tarde ha sido astronómico y estructuralmente debilitante; porque miren los números de sus inversiones:

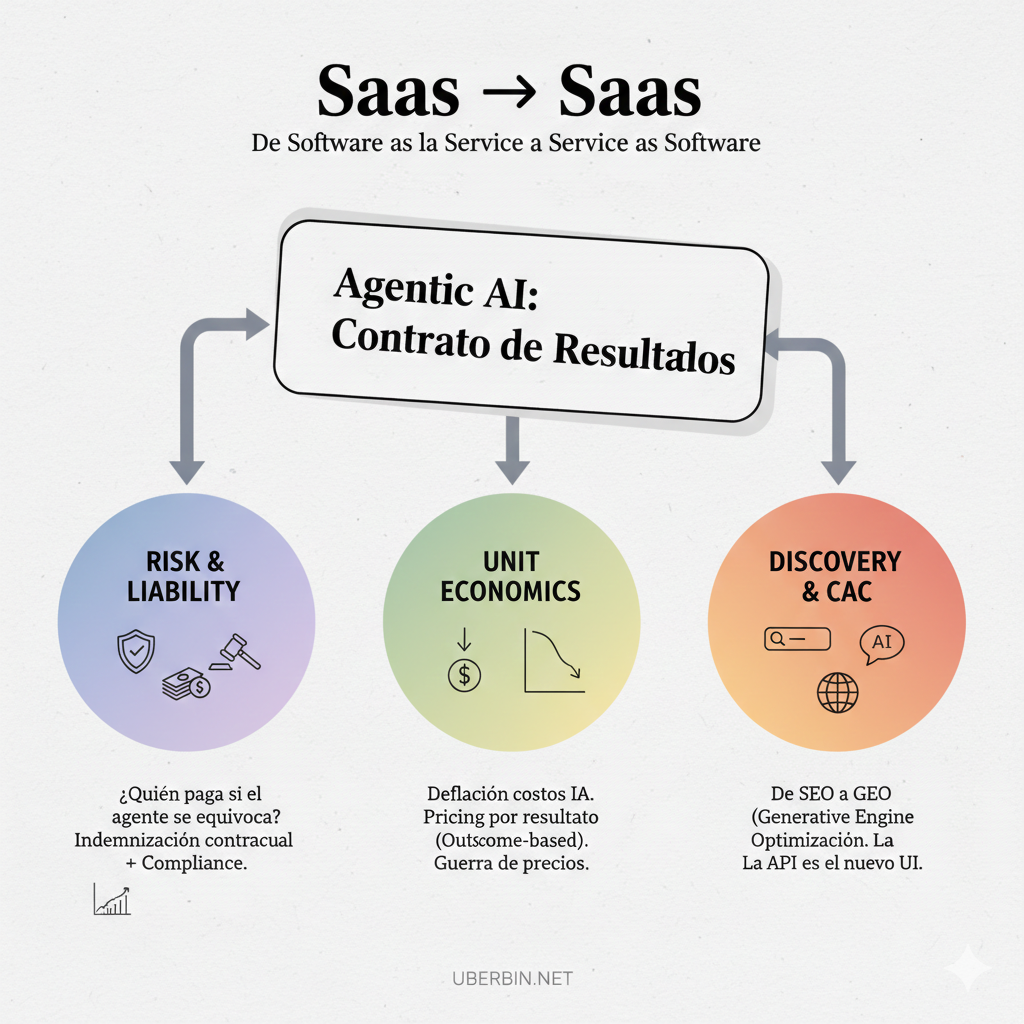

- Inversiones Reactivas y Desventajosas: Amazon invirtió $8,000M en Anthropic para obtener apenas un 7.8%, mientras Google obtuvo el doble de propiedad (~14%) por menos de la mitad del precio ($3,000M). Y lo de Anthropic no es exclusivo de Amazon; Microsoft y Google también invirtieron en ellos. El deal de $50,000M con OpenAI es el clímax de esta desesperación: pagar una prima masiva por un asiento en la mesa sin control real.

- Métricas de Mercado Devastadoras (Proyecciones 2026):

- Azure captura el 62% de los casos de estudio de IA empresarial vs. el 16% de Amazon.

- El crecimiento de Google Cloud (48%) acelera, mientras AWS (17-18%) se desacelera.

- Amazon planea gastar un capex brutal de $200,000 millones en 2026, lo que resultará en un flujo de caja libre negativo de hasta $28,000M.

Amazon está intentando ganar con fuerza bruta e infraestructura una carrera que se está disputando en los modelos, los productos y la experiencia de usuario. El hardware es necesario, pero ya no es suficiente.

La Ironía Final es que AWS salió de una posición de fortaleza absoluta. En 2022, eran los dueños del compute que el mundo necesitaba. Pero el mercado de AI no se jugaba solo en la infraestructura básica. Se jugaba en los ecosistemas y en la integración profunda de la inteligencia en el software.

Amazon llegó tarde, pagó más, obtuvo menos y apostó por socios que no le dan exclusividad. La pregunta de cara al futuro no es si AWS seguirá siendo una gran empresa de nube, sino si el costo de su tardanza en IA es estructuralmente irreversible, convirtiéndola en un proveedor de commodities de lujo en un mundo dominado por la inteligencia de Microsoft y Google.